自動微分を使用したカスタム学習

カスタム学習ループを使用した深層学習ネットワークの学習

タスクに必要な学習オプションが関数 trainingOptions に用意されていない場合、または関数 trainnet がサポートしていない損失関数がある場合は、カスタム学習ループを定義できます。層のネットワークとして指定できないモデルの場合は、モデルを関数として定義できます。詳細については、Custom Training Loopsを参照してください。

関数

トピック

カスタム学習ループ

- MATLAB による深層学習モデルの学習

MATLAB® で深層学習モデルに学習させる方法を習得する。 - Custom Loss Functions

Learn how to define and customize loss functions for deep learning workflows. - Custom Training Loops

Learn how to define and customize deep learning training loops and models. - Custom Training Loop Model Loss Functions

Learn how to define a model loss function for a custom training loop. - カスタム学習ループを使用したネットワークの学習

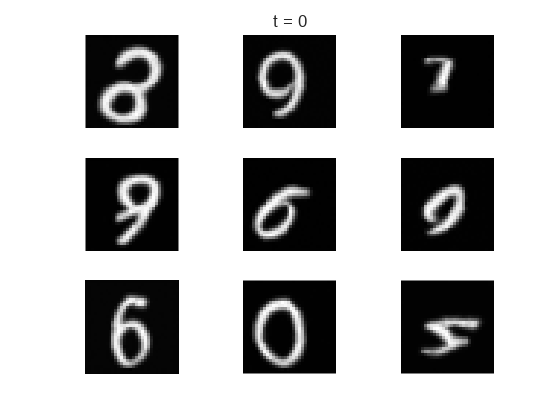

この例では、カスタム学習率スケジュールで手書きの数字を分類するネットワークに学習させる方法を示します。 - Train Sequence Classification Network Using Custom Training Loop

This example shows how to train a network that classifies sequences with a custom learning rate schedule. - カスタム学習ループでの学習オプションの指定

カスタム学習ループで一般的な学習オプションを指定する方法を学びます。 - Custom Training Loop Model Loss Functions

Learn how to define a model loss function for a custom training loop. - カスタム学習ループでのバッチ正規化統計量の更新

この例では、カスタム学習ループでネットワークの状態を更新する方法を示します。 - dlnetwork オブジェクトを使用した予測の実行

この例では、ミニバッチをループ処理することにより、dlnetworkオブジェクトを使用して予測を行う方法を示します。 - カスタム学習ループの進行状況の監視

カスタム学習ループの進行状況を追跡してプロットする。 - Compare Custom Solvers Using Custom Training Loop

This example shows how to train a deep learning network with different custom solvers and compare their accuracies. - 多入力および多出力ネットワーク

複数の入力または複数の出力がある深層学習ネットワークの定義と学習を行う方法を学びます。 - 複数の出力をもつネットワークの学習

この例では、手書きの数字のラベルと回転角度の両方を予測する、複数の出力をもつ深層学習ネットワークに学習させる方法を説明します。 - Cluster Data Using Self-Organizing Map (SOM)

This example shows how to train a self-organizing map (SOM) neural network to cluster unlabeled data. (R2026a 以降) - カスタム学習ループを使用したネットワークの並列学習

この例では、ネットワークに並列学習させるためのカスタム学習ループを設定する方法を説明します。 - Run Custom Training Loops on a GPU and in Parallel

Speed up custom training loops by running on a GPU, in parallel using multiple GPUs, or on a cluster. - Detect Issues During Deep Neural Network Training

This example shows how to automatically detect issues while training a deep neural network. - Speed Up Deep Neural Network Training

Learn how to accelerate deep neural network training.

自動微分

- 自動微分の背景

自動微分の機能を学びます。 - 深層学習のデータ形式

深層学習のデータ形式について学ぶ。 - dlarray をサポートする関数の一覧

dlarrayオブジェクトをサポートする関数の一覧を表示します。 - Deep Learning Toolbox での自動微分の使用

深層学習での自動微分の使用方法を示します。

敵対的生成ネットワーク

- 敵対的生成ネットワーク (GAN) の学習

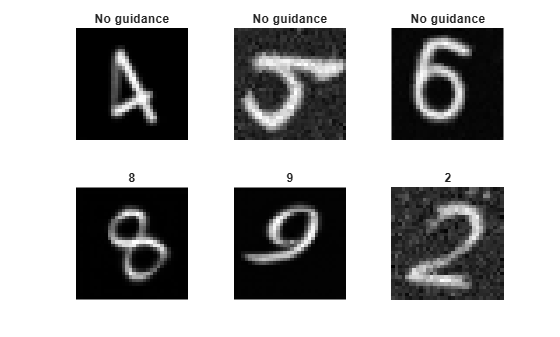

この例では、敵対的生成ネットワークに学習させてイメージを生成する方法を説明します。 - 条件付き敵対的生成ネットワーク (CGAN) の学習

この例では、条件付き敵対的生成ネットワークに学習させてイメージを生成する方法を説明します。 - Wasserstein GAN with Gradient Penalty (WGAN-GP) の学習

この例では、Wasserstein generative adversarial network with a gradient penalty (WGAN-GP) に学習させてイメージを生成する方法を説明します。

グラフ ニューラル ネットワーク

- Multivariate Time Series Anomaly Detection Using Graph Neural Network

This example shows how to detect anomalies in multivariate time series data using a graph neural network (GNN). - グラフ畳み込みネットワークを使用したノード分類

この例では、グラフ畳み込みネットワーク (GCN) を使用してグラフ内のノードを分類する方法を説明します。 - Multilabel Graph Classification Using Graph Attention Networks

This example shows how to classify graphs that have multiple independent labels using graph attention networks (GATs).

深層学習関数の高速化

- Deep Learning Function Acceleration

Accelerate model functions and model loss functions by caching and reusing traces. - Accelerate Custom Training Loop Functions

This example shows how to accelerate deep learning custom training loop and prediction functions. - 高速化された深層学習関数の出力のチェック

この例では、高速化された関数の出力が基になる関数の出力と一致するかどうかをチェックする方法を説明します。 - Evaluate Performance of Accelerated Deep Learning Function

This example shows how to evaluate the performance gains of using an accelerated function.