調整

関数 trainingOptions を使用してオプションを設定する方法については、パラメーターの設定と畳み込みニューラル ネットワークの学習を参照してください。適切な開始オプションを指定した後、実験マネージャーを使用してハイパーパラメーターの自動スイープまたはベイズ最適化を行えます。

敵対的サンプルを生成して、ネットワークのロバスト性を調査します。その後、Fast Gradient Sign Method (FGSM) による敵対的学習を使用し、敵対的摂動に対してロバストなネットワークに学習させます。

アプリ

| ディープ ネットワーク デザイナー | 深層学習ネットワークの設計と可視化 |

オブジェクト

trainingProgressMonitor | 深層学習カスタム学習ループの学習進行状況の監視およびプロット (R2022b 以降) |

関数

trainingOptions | 深層学習ニューラル ネットワークの学習のオプション |

trainnet | 深層学習ニューラル ネットワークの学習 (R2023b 以降) |

トピック

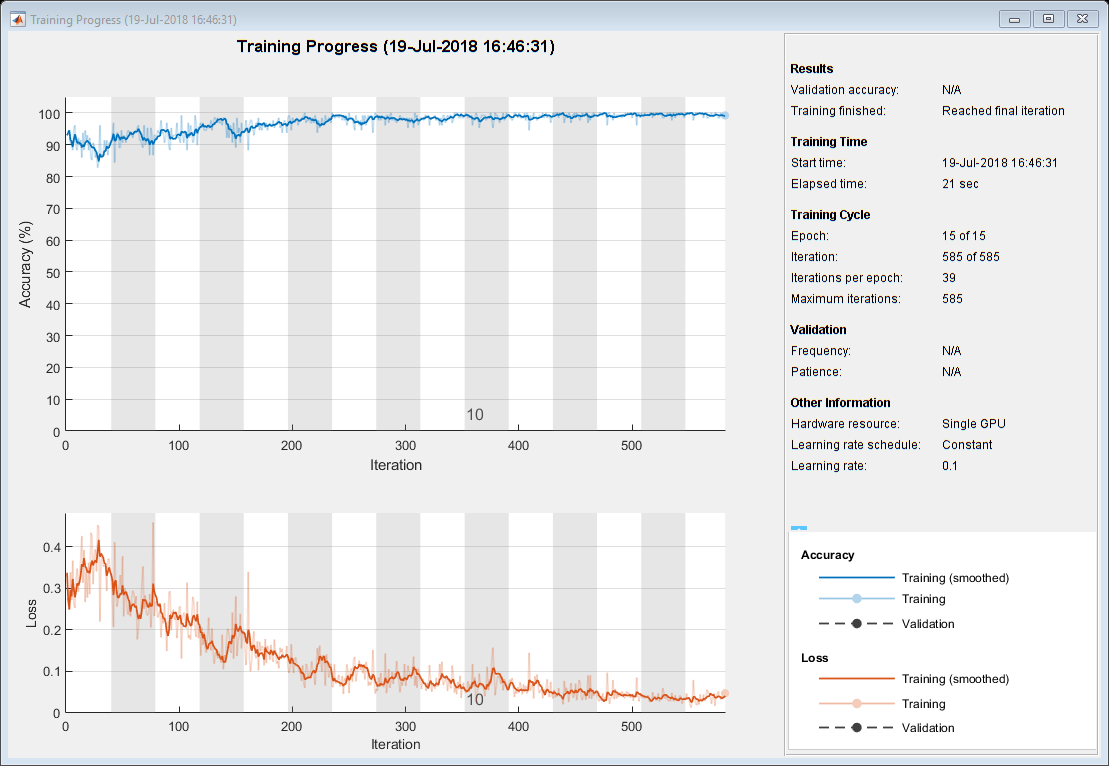

- パラメーターの設定と畳み込みニューラル ネットワークの学習

畳み込みニューラル ネットワークの学習パラメーターの設定方法を学習する。

- ベイズ最適化を使用した深層学習

この例では、深層学習にベイズ最適化を適用して、畳み込みニューラル ネットワークに最適なネットワーク ハイパーパラメーターと学習オプションを求める方法を説明します。

- Detect Issues During Deep Neural Network Training

This example shows how to automatically detect issues while training a deep neural network.

- 深層学習ネットワークの並列学習

この例では、ローカル マシンで複数の深層学習実験を実行する方法を説明します。

- カスタム学習ループを使用したネットワークの学習

この例では、カスタム学習率スケジュールで手書きの数字を分類するネットワークに学習させる方法を示します。

- 活性化層の比較

この例では、ReLU 活性化層、leaky ReLU 活性化層、ELU 活性化層、Swish 活性化層を使用してネットワークの学習精度を比較する方法を説明します。

- 深層学習のヒントとコツ

深層学習ネットワークの精度を改善する方法を学習する。

- Speed Up Deep Neural Network Training

Learn how to accelerate deep neural network training.

- Profile Your Deep Learning Code to Improve Performance

This example shows how to profile deep learning training code to identify and resolve performance issues. (R2024b 以降)

- カスタム重み初期化関数の指定

この例では、leaky ReLU 層が続く畳み込み層のカスタム He 重み初期化関数を作成する方法を示します。

- 層の重み初期化子の比較

この例では、さまざまな重み初期化子を使用して深層学習ネットワークに学習させる方法を示します。

- Create Custom Deep Learning Training Plot

This example shows how to create a custom training plot that updates at each iteration during training of deep learning neural networks using

trainnet. (R2023b 以降) - 深層学習における学習用のカスタム停止条件

この例では、

trainnetを使用し、カスタム停止条件に基づいて深層学習ニューラル ネットワークの学習を停止する方法を示します。 (R2023b 以降)