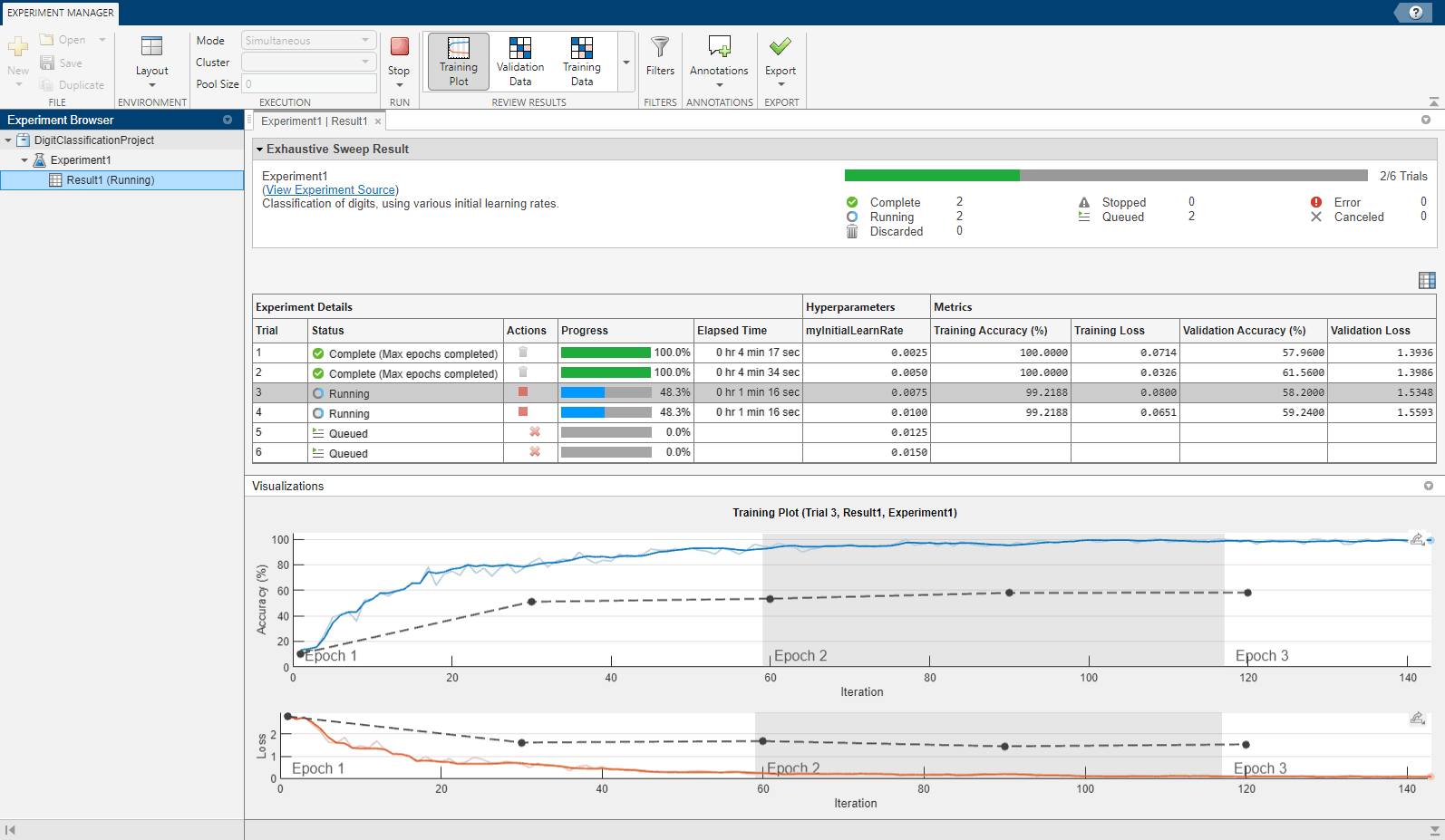

実験マネージャー

深層学習ネットワークの学習および比較に向けた実験の作成と実行

説明

実験マネージャー アプリを使用すると、異なる学習条件でネットワークに学習させて結果を比較するための深層学習実験を作成できます。実験マネージャーを使用すると、たとえば以下を行うことができます。

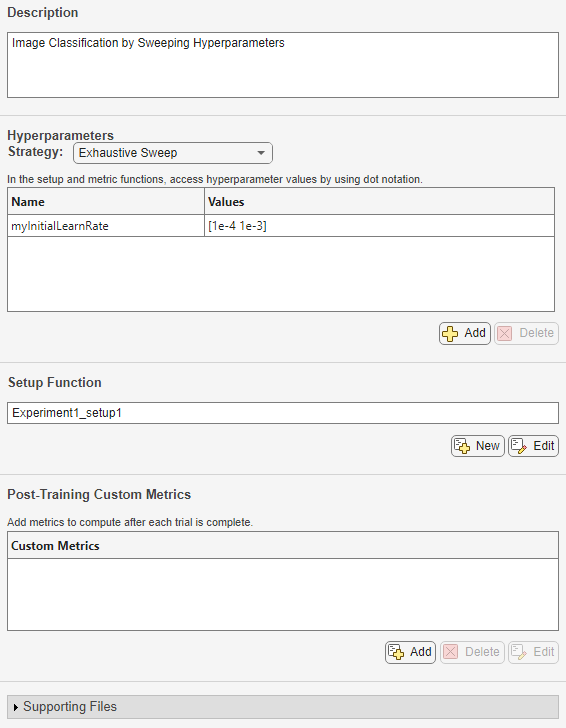

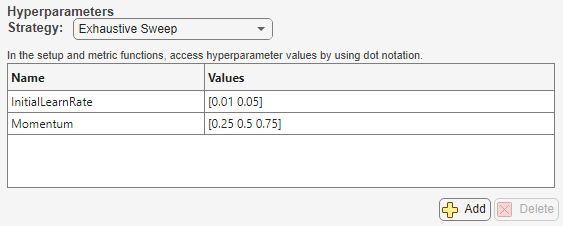

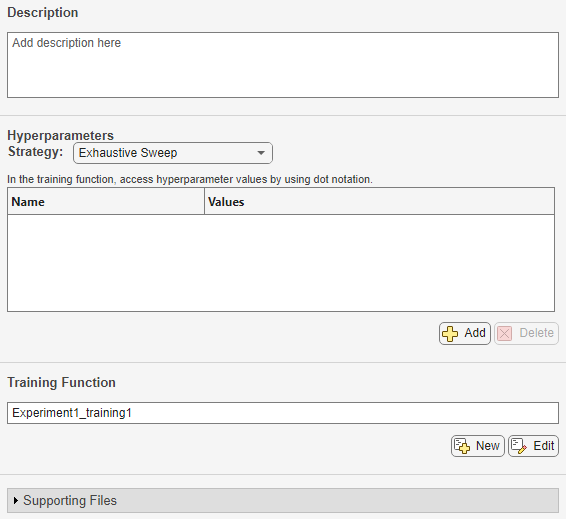

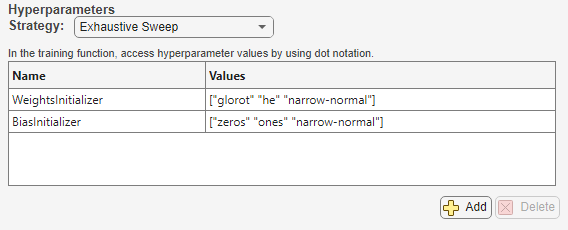

ハイパーパラメーター値の範囲のスイープ、ベイズ最適化の使用による最適な学習オプションの検出、または確率分布からのハイパーパラメーター値の無作為抽出。ベイズ最適化および無作為抽出の手法を使用するには、Statistics and Machine Learning Toolbox™ が必要です。

組み込み関数

trainnetの使用、または独自のカスタム学習関数の定義。さまざまなデータ セットを使用した結果の比較、またはさまざまな深いネットワークのアーキテクチャのテスト。

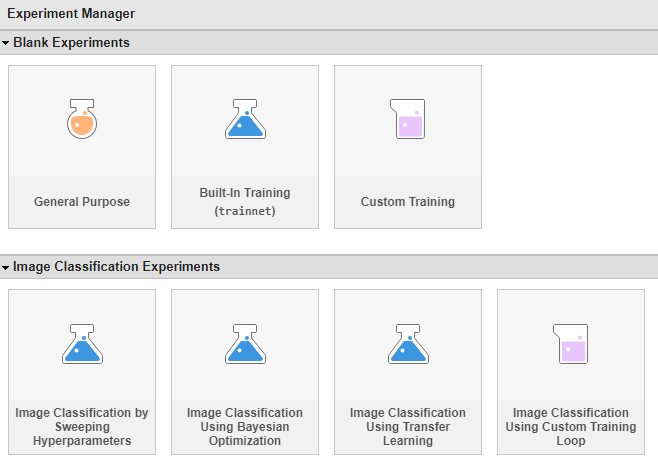

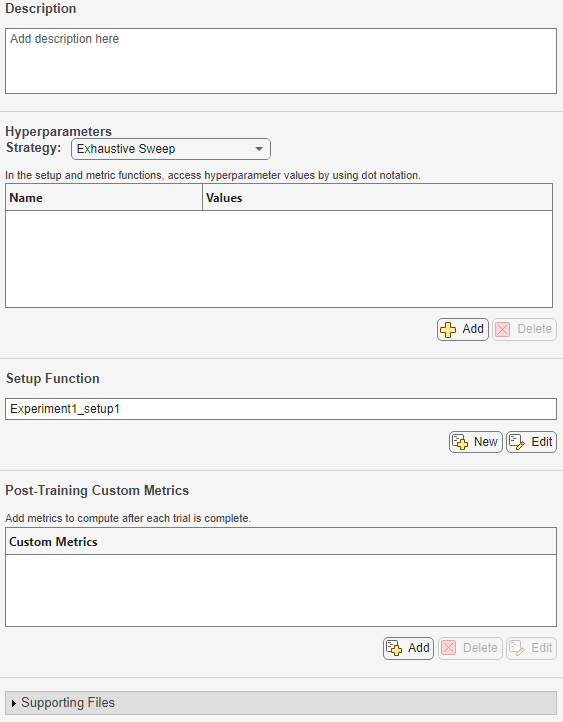

実験をすばやくセットアップするために、事前構成済みのテンプレートを使用して開始できます。実験テンプレートは、イメージ分類とイメージ回帰、シーケンス分類、オーディオ分類、信号処理、セマンティック セグメンテーション、およびカスタム学習ループといったワークフローをサポートします。

[実験ブラウザー] パネルには、プロジェクトの実験と結果の階層が表示されます。実験名の横にあるアイコンは、実験のタイプを表します。

— 学習関数

— 学習関数 trainnetを使用する組み込み学習実験 — カスタム学習関数を使用するカスタムの学習実験

— カスタム学習関数を使用するカスタムの学習実験 — ユーザーが作成した実験関数を使用する汎用の実験

— ユーザーが作成した実験関数を使用する汎用の実験

このページには、Deep Learning Toolbox™ 用の組み込み学習実験とカスタムの学習実験に関する情報を掲載しています。アプリの使用に関する一般的な情報については、実験マネージャーを参照してください。実験マネージャー アプリを分類学習器アプリおよび回帰学習器アプリと組み合わせて使用する方法の詳細については、実験マネージャー (Statistics and Machine Learning Toolbox)を参照してください。

必要な製品

Deep Learning Toolbox を使用して、深層学習のための組み込みまたはカスタムの学習実験を実行し、それらの実験の混同行列を表示する。

Statistics and Machine Learning Toolbox を使用して、ベイズ最適化を使用する機械学習および実験のためのカスタムの学習実験を実行する。

Parallel Computing Toolbox™ を使用して、複数の GPU、1 つのクラスター、またはクラウドで、複数の試行を同時に実行したり、単一の試行を実行したりする。詳細については、Run Experiments in Parallelを参照してください。

MATLAB® Parallel Server™ を使用して、リモート クラスターのバッチ ジョブとして実験をオフロードする。詳細については、Offload Experiments as Batch Jobs to a Clusterを参照してください。

実験マネージャー アプリを開く

MATLAB ツールストリップ: [アプリ] タブの [MATLAB] にある [実験マネージャー] アイコンをクリックします。

MATLAB コマンド プロンプト:

experimentManagerと入力します。

アプリの使用に関する一般的な情報については、実験マネージャーを参照してください。

例

関連する例

- 分類用の深層学習実験の作成

- 回帰用の深層学習実験の作成

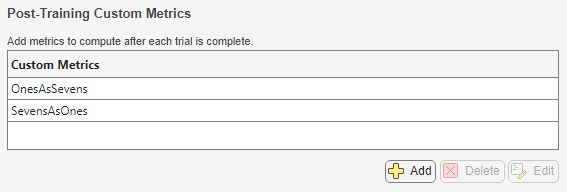

- Evaluate Deep Learning Experiments by Using Metric Functions

- Tune Experiment Hyperparameters by Using Bayesian Optimization

- Use Bayesian Optimization in Custom Training Experiments

- Try Multiple Pretrained Networks for Transfer Learning

- Experiment with Weight Initializers for Transfer Learning

- Audio Transfer Learning Using Experiment Manager

- Choose Training Configurations for LSTM Using Bayesian Optimization

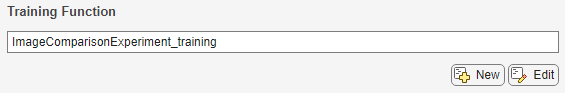

- Run a Custom Training Experiment for Image Comparison

- Use Experiment Manager to Train Generative Adversarial Networks (GANs)

- Custom Training with Multiple GPUs in Experiment Manager

詳細

ヒント

ネットワークの可視化と構築を行うには、ディープ ネットワーク デザイナー アプリを使用します。

実験のサイズを小さくするには、不要になった試行の結果と可視化を破棄します。結果テーブルの [アクション] 列で、試行の破棄ボタン

をクリックします。

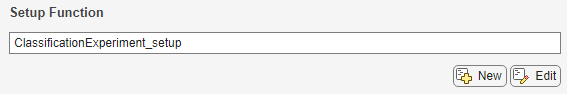

をクリックします。セットアップ関数では、ドット表記を使用してハイパーパラメーター値にアクセスします。詳細については、構造体配列を参照してください。

バッチ正規化層が含まれているネットワークで、

BatchNormalizationStatistics学習オプションがpopulationの場合、学習時に評価される検証メトリクスとは異なる最終検証メトリクス値が実験マネージャーに表示されることがよくあります。値の違いは、ネットワークの学習終了後に実行された追加の演算によるものです。詳細については、バッチ正規化層を参照してください。