このページの内容は最新ではありません。最新版の英語を参照するには、ここをクリックします。

vision.PointTracker

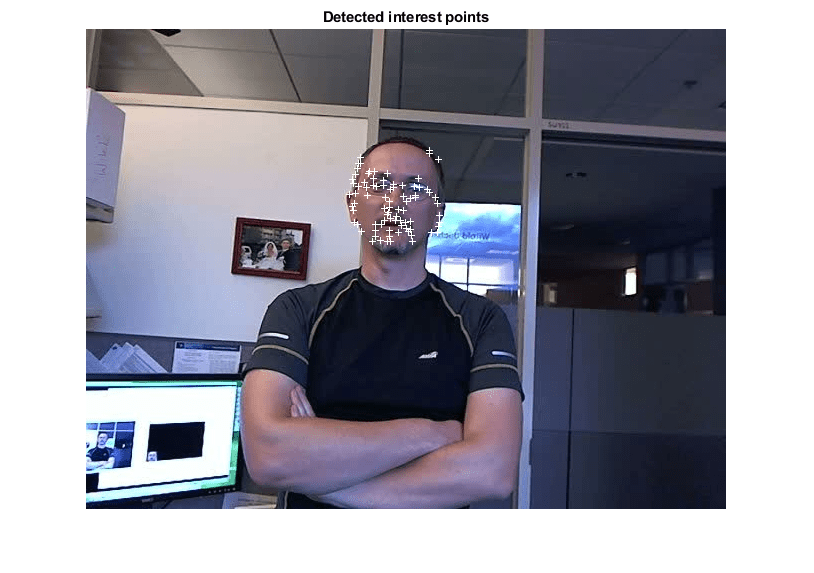

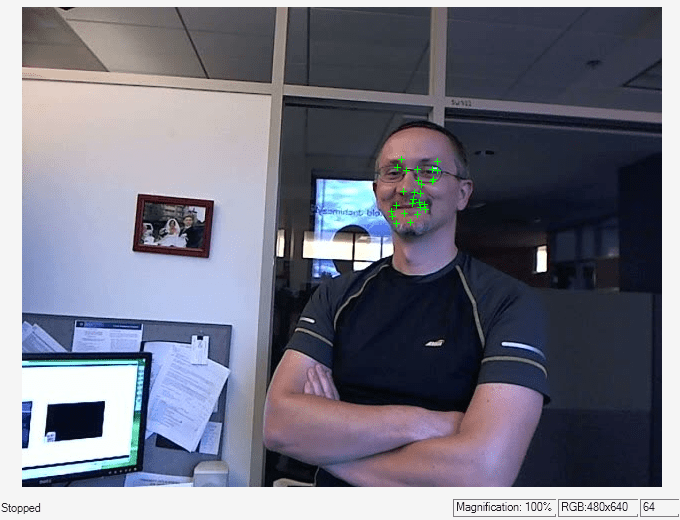

Kanade-Lucas-Tomasi (KLT) アルゴリズムを使用したビデオ内の点の追跡

説明

ポイント トラッカー オブジェクトは、Kanade-Lucas-Tomasi (KLT) 特徴追跡アルゴリズムを使用して一連の点を追跡します。ポイント トラッカーを使用して、映像安定化、カメラの動き推定およびオブジェクト追跡を行うことができます。これは特に、形状が変化しないオブジェクトや視覚的なテクスチャを表すオブジェクトの追跡に効果的です。ポイント トラッカーは、大規模な追跡フレームワークの一部として短時間の追跡を行う場合によく使用されます。

ポイント トラッカー アルゴリズムの進行に伴い、ライティングの変化、面外の回転または関節運動によって点が失われる場合があります。長時間にわたってオブジェクトを追跡するには、点の定期的な再取得が必要になる場合があります。

一連の点の追跡:

vision.PointTrackerオブジェクトを作成し、そのプロパティを設定します。関数と同様に、引数を指定してオブジェクトを呼び出します。

System object の機能の詳細については、System object とはを参照してください。

作成

説明

pointTracker = vision.PointTracker は、ビデオ内の一連の点を追跡するポイント トラッカーオブジェクトを返します。

pointTracker = vision.PointTracker(Name,Value)pointTracker = vision.PointTracker('NumPyramidLevels',3) です。

追跡プロセスの初期化

追跡プロセスを初期化するには、initialize を使用して、点と初期ビデオ フレームの初期位置を指定しなければなりません。

initialize(pointTracker,points,I) は、追跡する点を初期化して、初期ビデオ フレームを設定します。初期位置 points は、[x y] 座標の M 行 2 列の配列でなければなりません。初期ビデオ フレーム I は、2 次元グレースケール イメージまたは RGB イメージで、サイズとデータ型がオブジェクトに渡されたビデオ フレームと同じでなければなりません。

追跡の初期点を取得するには、関数 detectFASTFeatures、detectSURFFeatures、detectHarrisFeatures、detectMinEigenFeatures など、多くの方法があります。

プロパティ

使用法

構文

説明

[ は、入力フレーム points,point_validity] = pointTracker(I)I 内の点を追跡します。

[ は各点の信頼度スコアも返します。points,point_validity,scores] = pointTracker(I)

setPoints(pointTracker, は、追跡する点を設定します。この関数は、追跡する点について [x y] 座標の M 行 2 列の points)points 配列を設定します。追跡中に多くの点が失われ、これらの点を再検出する必要がある場合には、この関数を使用できます。

setPoints(pointTracker, はさらに、点を有効または無効としてマークできます。長さ M の入力 logical ベクトル points,point_validity)point_validity には、追跡される点の有効性に対応する true 値または false 値が含まれます。長さ M は、点の数に対応します。false 値は、追跡されない無効な点を示します。たとえば、この関数と関数 estgeotform2d を使用して、前のフレームと現在のフレームでの点の位置の変化を判定できます。外れ値は無効としてマークできます。

入力引数

出力引数

オブジェクト関数

オブジェクト関数を使用するには、System object™ を最初の入力引数として指定します。たとえば、obj という名前の System object のシステム リソースを解放するには、次の構文を使用します。

release(obj)

例

参照

[1] Lucas, Bruce D. and Takeo Kanade. “An Iterative Image Registration Technique with an Application to Stereo Vision,”Proceedings of the 7th International Joint Conference on Artificial Intelligence, April, 1981, pp. 674–679.

[2] Tomasi, Carlo and Takeo Kanade. Detection and Tracking of Point Features, Computer Science Department, Carnegie Mellon University, April, 1991.

[3] Shi, Jianbo and Carlo Tomasi. “Good Features to Track,” IEEE Conference on Computer Vision and Pattern Recognition, 1994, pp. 593–600.

[4] Kalal, Zdenek, Krystian Mikolajczyk, and Jiri Matas. “Forward-Backward Error: Automatic Detection of Tracking Failures,” Proceedings of the 20th International Conference on Pattern Recognition, 2010, pages 2756–2759, 2010.

拡張機能

バージョン履歴

R2012b で導入