深層ニューラル ネットワークの学習

組み込み学習関数またはカスタム学習ループを使用したネットワークの学習

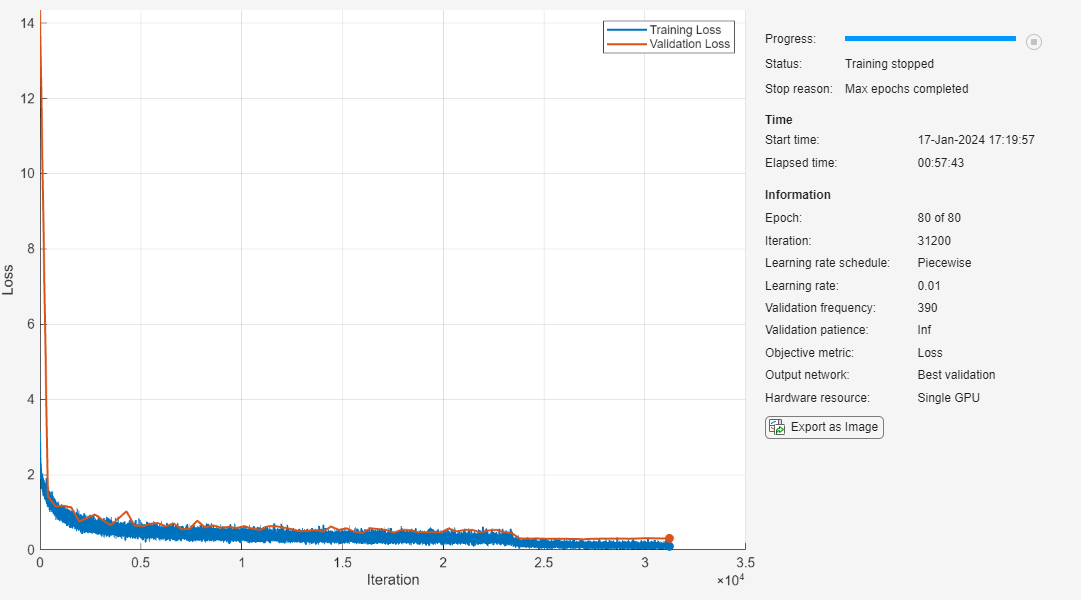

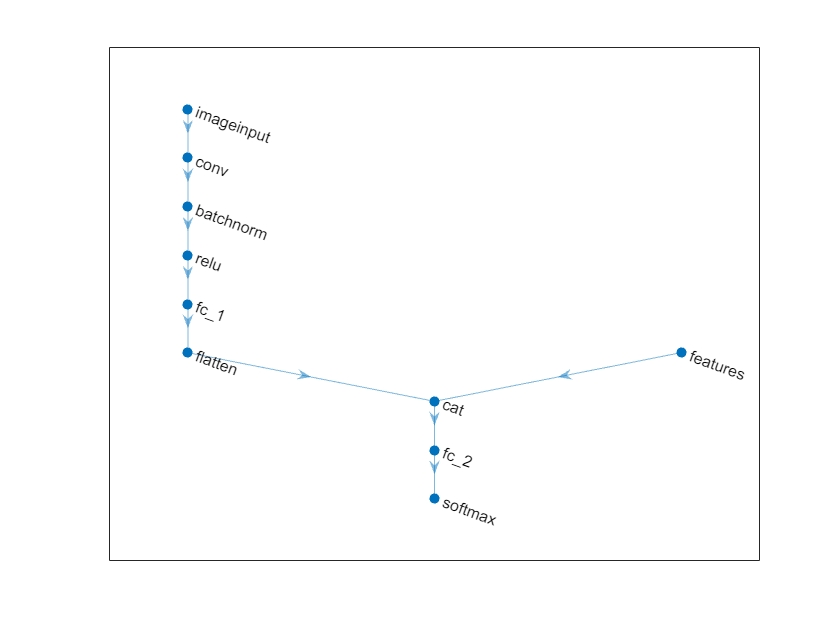

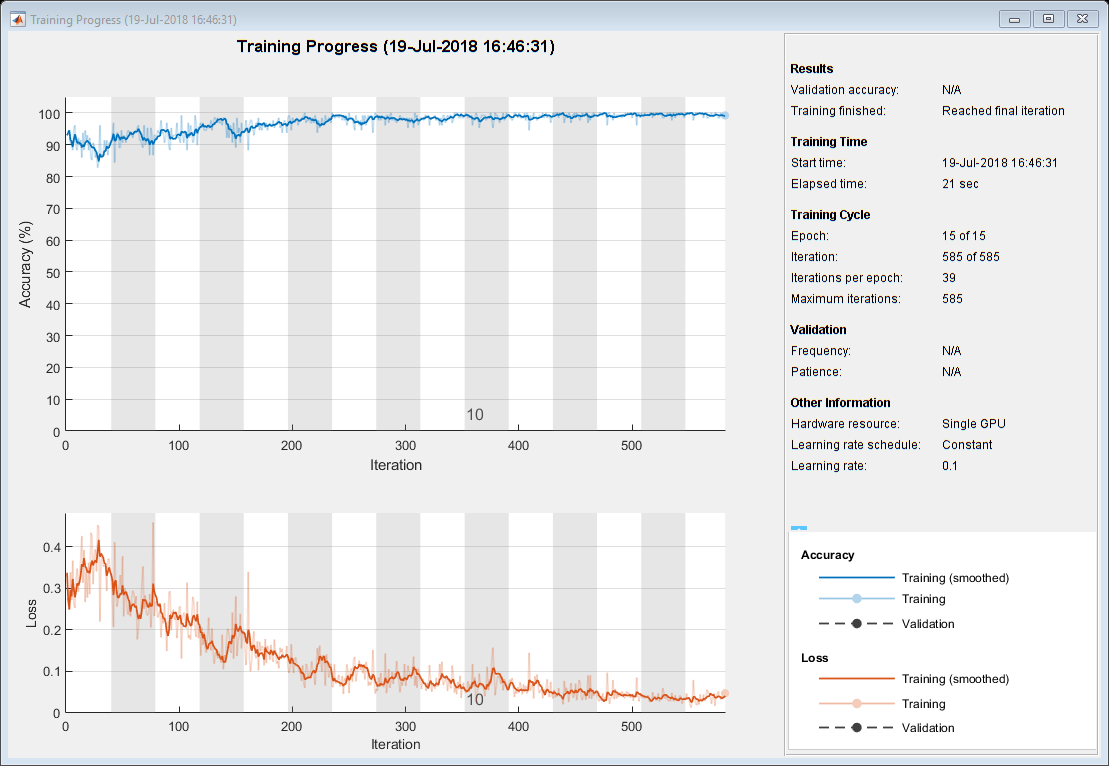

ネットワーク アーキテクチャを定義した後、関数 trainingOptions を使用して学習パラメーターを定義できます。その後、関数 trainnet を使用してネットワークに学習させることができます。学習済みネットワークを使用して、クラス ラベルまたは数値応答を予測します。

ニューラル ネットワークの学習は、1 つの CPU または GPU か複数の CPU または GPU で行うことも、クラスターまたはクラウドで並列に行うこともできます。1 つの GPU または並列で学習させる場合は、Parallel Computing Toolbox™ が必要です。GPU を使用するには、サポートされている GPU デバイスが必要です (サポートされているデバイスの詳細については、GPU 計算の要件 (Parallel Computing Toolbox)を参照してください)。関数 trainingOptions を使用して、実行環境を指定します。

タスクに必要な学習オプションが関数 trainingOptions に用意されていない場合、または必要な損失関数をカスタム出力層がサポートしていない場合、カスタム学習ループを定義できます。層のネットワークとして指定できないモデルの場合は、モデルを関数として定義できます。詳細については、Custom Training Loopsを参照してください。

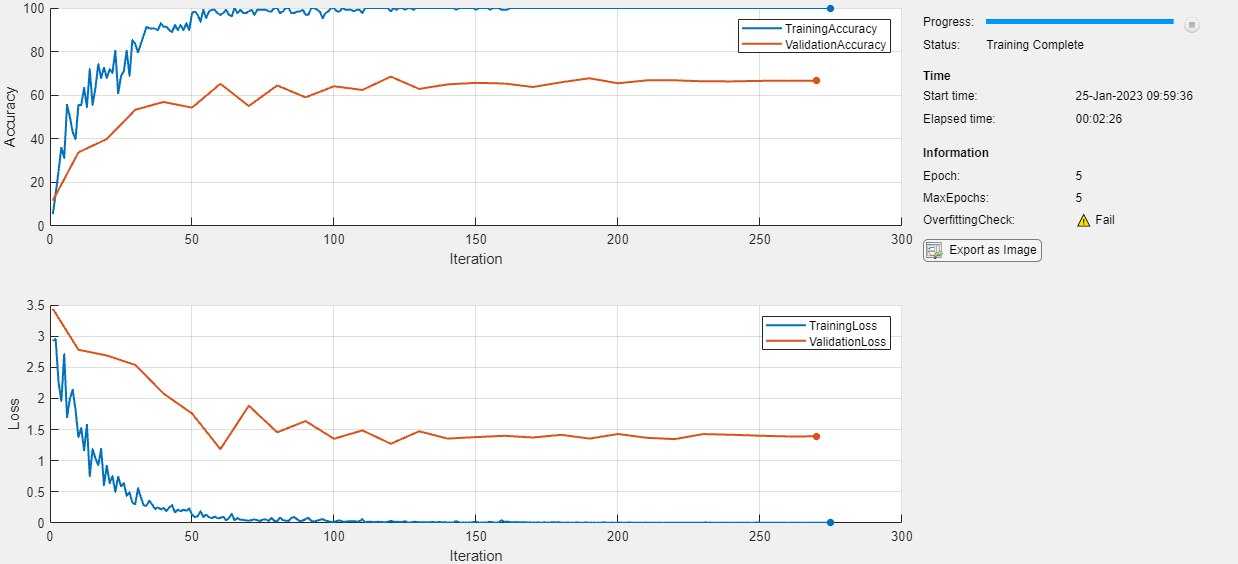

適切な開始オプションを指定した後、実験マネージャーを使用してハイパーパラメーターの自動スイープまたはベイズ最適化を行えます。実験マネージャーを使用し、実験を並列で実行して異なる学習構成を同時にテストし、学習プロットで進行状況を監視します。

カテゴリ

- 組み込み学習

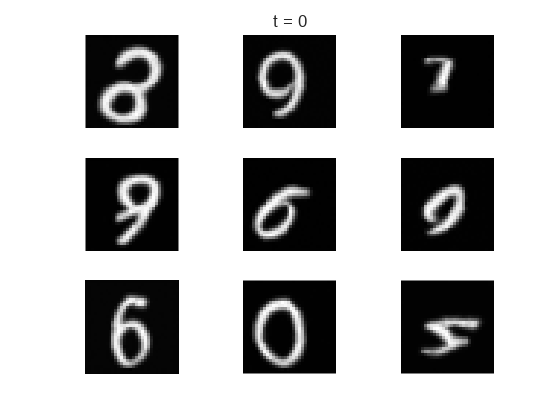

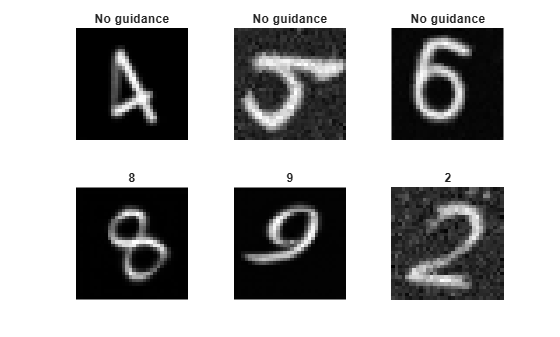

組み込み学習関数を使用した深層学習ネットワークの学習

- 自動微分を使用したカスタム学習

カスタム学習ループを使用した深層学習ネットワークの学習

- 調整

プログラムによる学習オプションの調整、チェックポイントからの学習の再開、敵対的サンプルの調査

- 実験の管理

複数の初期条件でのネットワークの学習、対話形式での学習オプションの調整、結果の評価

- 並列とクラウド

ローカルまたはクラウドでの複数の GPU を使用した深層学習のスケールアップ、対話形式またはバッチ ジョブによる複数のネットワークの学習