layerGraph

(非推奨) 深層学習用のネットワーク層のグラフ

説明

層グラフは、深層学習層の有向非循環グラフ (DAG) としてニューラル ネットワークのアーキテクチャを指定します。この層は、複数の入力と複数の出力をもつことができます。

作成

説明

入力引数

プロパティ

オブジェクト関数

addLayers | ニューラル ネットワークへの層の追加 |

removeLayers | ニューラル ネットワークからの層の削除 |

replaceLayer | ニューラル ネットワークの層の置き換え |

connectLayers | ニューラル ネットワークの層の結合 |

disconnectLayers | ニューラル ネットワークの層の切り離し |

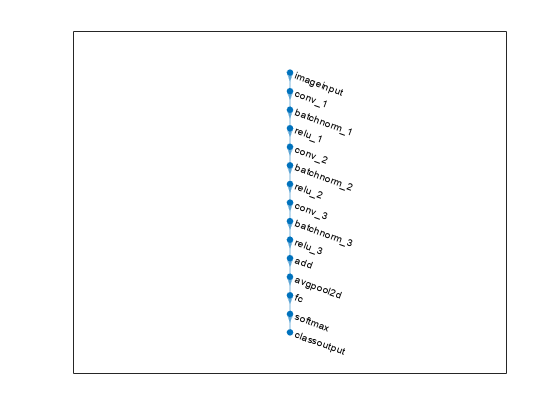

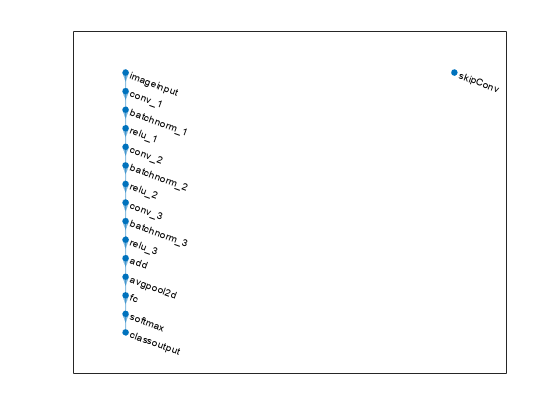

plot | ニューラル ネットワーク アーキテクチャのプロット |

例

制限

層グラフ オブジェクトには、量子化情報は含まれません。量子化されたネットワークから層グラフを抽出し、次に

assembleNetworkまたはdlnetworkを使用してネットワークを再構築すると、ネットワークから量子化情報が削除されます。