このページの内容は最新ではありません。最新版の英語を参照するには、ここをクリックします。

evaluateSemanticSegmentation

グラウンド トゥルースに対してセマンティック セグメンテーション データ セットを評価する

構文

説明

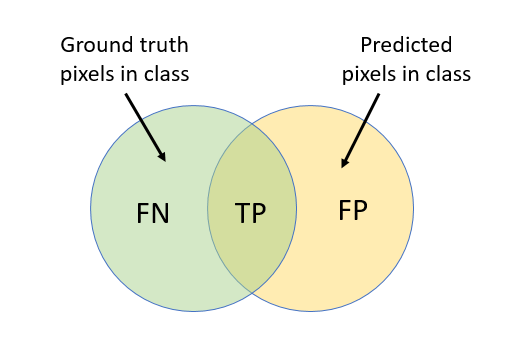

ssm = evaluateSemanticSegmentation(imageSetConfusion,classNames)classNames をもつ混同行列 imageSetConfusion からのセマンティック セグメンテーションの結果の品質を評価します。

[ は、さまざまなメトリクスを計算し、クラス ssm,blockMetrics] = evaluateSemanticSegmentation(blockSetConfusion,classNames)classNames をもつ混同行列 blockSetConfusion からのブロックベース セマンティック セグメンテーションの結果の品質を評価します。

[___] = evaluateSemanticSegmentation(___, は、評価を制御するために、Name,Value)Name,Value の引数のペアを 1 つ以上使用してセマンティック セグメンテーション メトリクスを計算します。

例

入力引数

名前と値の引数

出力引数

ヒント

関数

evaluateSemanticSegmentationを使用した場合、データセット、クラス、またはイメージ メトリクスのNaNの値は、メトリクスの計算中に 1 つ以上のクラスが欠損していたことを示しています。この場合、ソフトウェアはメトリクスを正確に計算できていません。欠損しているクラスは

ClassMetricsプロパティを調べるとわかります。このプロパティでは各クラスのメトリクスが提供されます。ネットワークをさらに正確に評価するには、欠損しているクラスを含むさらに多くのデータを使用してグラウンド トゥルースを拡張します。

参照

[1] Csurka, G., D. Larlus, and F. Perronnin. "What is a good evaluation measure for semantic segmentation?" Proceedings of the British Machine Vision Conference, 2013, pp. 32.1–32.11.

拡張機能

バージョン履歴

R2017b で導入

参考

関数

semanticseg|plotconfusion(Deep Learning Toolbox) |jaccard|bfscore|segmentationConfusionMatrix

オブジェクト

トピック

- ブロックベースのワークフローにおけるセグメンテーション メトリクスの計算

- 深層学習を使用したセマンティック セグメンテーション入門

- 深層学習用のデータストア (Deep Learning Toolbox)