classify

判別分析を使用した観測値の分類

構文

説明

メモ

判別分析分類器の学習とラベルの予測には、classify よりも fitcdiscr と predict が推奨されます。fitcdiscr は交差検証とハイパーパラメーター最適化をサポートし、新しい予測または事前確率の変更を行うたびに分類器を当てはめる必要はありません。

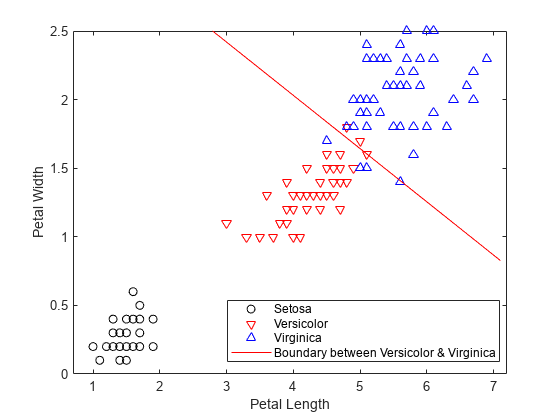

class = classify(sample,training,group)sample 内のデータの各行を training 内のデータが属するグループのいずれかに分類します。training のグループは group で指定します。この関数は、sample の各行について割り当てられたグループが格納された class を返します。

例

入力引数

出力引数

代替機能

関数 fitcdiscr は判別分析も実行します。関数 fitcdiscr を使用して分類器に学習をさせ、関数 predict を使用して新しいデータのラベルを予測することができます。関数 fitcdiscr は交差検証とハイパーパラメーター最適化をサポートします。新しい予測または事前確率の変更を行うたびに分類器を当てはめる必要はありません。

参照

[1] Krzanowski, Wojtek. J. Principles of Multivariate Analysis: A User's Perspective. NY: Oxford University Press, 1988.

[2] Seber, George A. F. Multivariate Observations. NJ: John Wiley & Sons, Inc., 1984.

バージョン履歴

R2006a より前に導入