predict

k 最近傍分類モデルの使用によるラベルの予測

説明

例

フィッシャーのアヤメのデータに対して k 最近傍分類器を作成します。ここで k = 5 です。新しいデータでいくつかのモデル予測を評価します。

フィッシャーのアヤメのデータ セットを読み込みます。

load fisheriris

X = meas;

Y = species;5 つの最近傍について分類器を作成します。非カテゴリカル予測子データを標準化します。

mdl = fitcknn(X,Y,'NumNeighbors',5,'Standardize',1);

最小、平均および最大の特性をもつ花の分類を予測します。

Xnew = [min(X);mean(X);max(X)]; [label,score,cost] = predict(mdl,Xnew)

label = 3×1 cell

{'versicolor'}

{'versicolor'}

{'virginica' }

score = 3×3

0.4000 0.6000 0

0 1.0000 0

0 0 1.0000

cost = 3×3

0.6000 0.4000 1.0000

1.0000 0 1.0000

1.0000 1.0000 0

スコア行列とコスト行列の 2 行目および 3 行目にはバイナリ値が格納されます。つまり、花の測定値の平均値と最大値に対する 5 つの最近傍はすべて同じ分類になります。

"k" 最近傍分類器にさまざまな "k" の値で学習させ、分類器の判定境界を比較します。

fisheriris データ セットを読み込みます。

load fisheririsこのデータ セットには、3 種のアヤメの花のがく片と花弁からの長さと幅の測定値が含まれています。がく片の長さと幅および観測済みのすべての setosa 種のアヤメを削除します。

inds = ~strcmp(species,'setosa');

X = meas(inds,3:4);

species = species(inds); バイナリ ラベル変数 y を作成します。ラベルは、virginica 種のアヤメが 1 で、versicolor 種が 0 です。

y = strcmp(species,'virginica');"k" 最近傍分類器に学習させます。検出する最近傍の数として 5 を指定し、予測子データを標準化します。

EstMdl = fitcknn(X,y,'NumNeighbors',5,'Standardize',1)

EstMdl =

ClassificationKNN

ResponseName: 'Y'

CategoricalPredictors: []

ClassNames: [0 1]

ScoreTransform: 'none'

NumObservations: 100

Distance: 'euclidean'

NumNeighbors: 5

Properties, Methods

EstMdl は学習させた ClassificationKNN 分類器です。そのプロパティの一部がコマンド ウィンドウに表示されます。

2 つのアヤメの種類をそれらの特徴に基づいて区別する判定境界の線をプロットします。

x1 = min(X(:,1)):0.01:max(X(:,1)); x2 = min(X(:,2)):0.01:max(X(:,2)); [x1G,x2G] = meshgrid(x1,x2); XGrid = [x1G(:),x2G(:)]; pred = predict(EstMdl,XGrid); figure gscatter(XGrid(:,1),XGrid(:,2),pred,[1,0,0;0,0.5,1]) hold on plot(X(y == 0,1),X(y == 0,2),'ko', ... X(y == 1,1),X(y == 1,2),'kx') xlabel('Petal length (cm)') ylabel('Petal width (cm)') title('{\bf 5-Nearest Neighbor Classifier Decision Boundary}') legend('Versicolor Region','Virginica Region', ... 'Sampled Versicolor','Sampled Virginica', ... 'Location','best') axis tight hold off

赤と青の領域間の分割が判定境界です。近傍数 "k" を変更すると、境界が変化します。

k = 1 (fitcknn の NumNeighbors の既定値) と k = 20 を使用して分類器に再学習させます。

EstMdl1 = fitcknn(X,y); pred1 = predict(EstMdl1,XGrid); EstMdl20 = fitcknn(X,y,'NumNeighbors',20); pred20 = predict(EstMdl20,XGrid); figure gscatter(XGrid(:,1),XGrid(:,2),pred1,[1,0,0;0,0.5,1]) hold on plot(X(y == 0,1),X(y == 0,2),'ko', ... X(y == 1,1),X(y == 1,2),'kx') xlabel('Petal length (cm)') ylabel('Petal width (cm)') title('{\bf 1-Nearest Neighbor Classifier Decision Boundary}') legend('Versicolor Region','Virginica Region', ... 'Sampled Versicolor','Sampled Virginica', ... 'Location','best') axis tight hold off

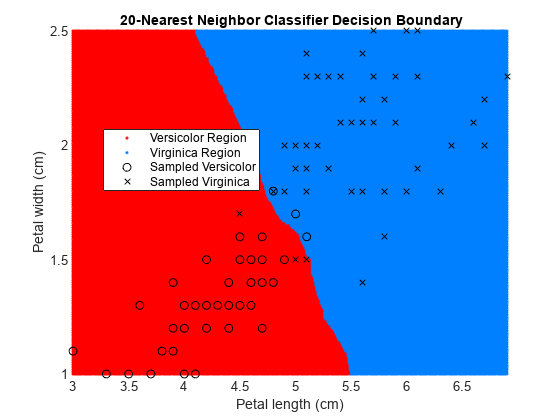

figure gscatter(XGrid(:,1),XGrid(:,2),pred20,[1,0,0;0,0.5,1]) hold on plot(X(y == 0,1),X(y == 0,2),'ko', ... X(y == 1,1),X(y == 1,2),'kx') xlabel('Petal length (cm)') ylabel('Petal width (cm)') title('{\bf 20-Nearest Neighbor Classifier Decision Boundary}') legend('Versicolor Region','Virginica Region', ... 'Sampled Versicolor','Sampled Virginica', ... 'Location','best') axis tight hold off

"k" が増えると判定境界が線形化しているように見えます。この線形化は、アルゴリズムで重み付けされる各入力の重要度が "k" の増加に伴って下がることによるものです。k = 1 の場合、ほぼすべての学習標本の種類がアルゴリズムで正しく予測されています。k = 20 の場合は、学習セット内でのアルゴリズムによる誤分類率が高くなっています。"k" の最適値は、fitcknn の名前と値の引数 OptimizeHyperparameters を使用して探すことができます。例については、当てはめた KNN 分類器の最適化を参照してください。

入力引数

k 最近傍分類モデル。ClassificationKNN オブジェクトを指定します。

分類対象の予測子データ。数値行列または table を指定します。

X の各行は 1 つの観測値に対応し、各列は 1 つの変数に対応します。

数値行列の場合

Xの列を構成する変数の順序は、mdlの学習に使用した予測子変数の順序と同じでなければなりません。table (たとえば

Tbl) を使用してmdlに学習させた場合、Tblに含まれている予測子変数がすべて数値変数であれば、Xを数値行列にすることができます。k 最近傍分類では、同質な種類の予測子が必要です。したがって、学習時にTbl内のすべての数値予測子を categorical として扱うには、fitcknnを使用して学習をさせるときに'CategoricalPredictors','all'を設定します。Tblに種類の異なる予測子 (数値および categorical データ型など) が混在し、Xが数値行列である場合、predictでエラーがスローされます。

table の場合

predictは、文字ベクトルの cell 配列ではない cell 配列と複数列の変数をサポートしません。table (たとえば

Tbl) を使用してmdlに学習をさせる場合、X内のすべての予測子変数は変数名およびデータ型が、(mdl.PredictorNamesに格納されている)mdlの学習に使用した変数と同じでなければなりません。ただし、Xの列の順序がTblの列の順序に対応する必要はありません。TblとXの両方に追加の変数 (応答変数や観測値の重みなど) を含めることができますが、predictはこれらを無視します。数値行列を使用して

mdlに学習をさせる場合、mdl.PredictorNames内の予測子名とX内の対応する予測子変数名が同じでなければなりません。学習時に予測子の名前を指定する方法については、fitcknnの名前と値のペアの引数PredictorNamesを参照してください。X内の予測子変数はすべて数値ベクトルでなければなりません。Xに追加の変数 (応答変数や観測値の重みなど) を含めることができますが、predictはこれらを無視します。

fitcknn で 'Standardize',true に設定して mdl を学習させた場合、X の列が mdl.Mu の対応する平均値と mdl.Sigma の標準偏差を使用して標準化されます。

データ型: double | single | table

出力引数

アルゴリズム

predict は、予測される誤分類コストを最小化することにより分類します。

ここで

は、予測された分類です。

K は、クラスの数です。

は、観測値 x のクラス j の事後確率です。

は、真のクラスが j の場合に観測値を y として分類するコストです。

ベクトル (単一のクエリ点) xnew とモデル mdl があるとします。

k は、予測に使用する最近傍の個数

mdl.NumNeighborsです。nbd(mdl,xnew)は、mdl.X内のxnewに対する k 個の最近傍を指定します。Y(nbd)は、nbd(mdl,xnew)における点の分類、つまりmdl.Y(nbd)を指定します。W(nbd)は、nbd(mdl,xnew)における点の重みを指定します。priorは、mdl.Y内のクラスの事前確率を指定します。

事前確率のベクトルがモデルに含まれている場合、観測値の重み W は合計が事前確率と等しくなるようにクラスによって正規化されます。xnew から mdl.X までの距離に重みが依存する可能性があるので、このプロセスには点 xnew についての計算が含まれる場合があります。

事後確率 p(j|xnew) は

ここで は、mdl.Y(i) = j である場合は 1、それ以外の場合は 0 です。

KNN 分類には、クラスごとの真の誤分類コストおよび観測値ごとの予測誤分類コストという 2 つのコストが関連付けられています。

fitcknn を実行するときに名前と値のペアの引数 'Cost' を使用することにより、クラスごとの真の誤分類コストを設定できます。値 Cost(i,j) は、真のクラスが i である観測値をクラス j に分類するコストです。既定では、Cost(i,j) = 1 (i ~= j の場合) および Cost(i,j) = 0 (i = j の場合) です。つまり、正しい分類のコストは 0、誤った分類のコストは 1 です。

KNN 分類には、クラスごとの真の誤分類コストおよび観測値ごとの予測誤分類コストという 2 つのコストが関連付けられています。predict の 3 番目の出力は、観測ごとの予測誤分類コストです。

学習済みの分類器 mdl を使用して Nobs 個の観測値を分類するとします。また、K 個のクラスがあるとします。1 行に 1 観測ずつ、観測値を行列 Xnew に置きます。次のコマンド

[label,score,cost] = predict(mdl,Xnew)

これは、他の出力に加えて、Nobs 行 K 列の行列 cost を返します。cost 行列の各行には、観測をそれぞれのクラス K に分類する予測 (平均) コストが含まれます。cost(n,j) は次のとおりです。

ここで

K は、クラスの数です。

は、観測値 Xnew(n) のクラス i の事後確率です。

は、真のクラスが i である観測値を j に分類する真の誤分類コストです。

代替機能

Simulink ブロック

Simulink® に最近傍分類モデルの予測を統合するには、Statistics and Machine Learning Toolbox™ ライブラリにある ClassificationKNN Predict ブロックを使用するか、MATLAB® Function ブロックを関数 predict と共に使用します。例については、ClassificationKNN Predict ブロックの使用によるクラス ラベルの予測とMATLAB Function ブロックの使用によるクラス ラベルの予測を参照してください。

使用するアプローチを判断する際は、以下を考慮してください。

Statistics and Machine Learning Toolbox ライブラリ ブロックを使用する場合、固定小数点ツール (Fixed-Point Designer)を使用して浮動小数点モデルを固定小数点に変換できます。

MATLAB Function ブロックを関数

predictと共に使用する場合は、可変サイズの配列に対するサポートを有効にしなければなりません。MATLAB Function ブロックを使用する場合、予測の前処理や後処理のために、同じ MATLAB Function ブロック内で MATLAB 関数を使用することができます。

拡張機能

predict 関数は、tall 配列を完全にサポートします。詳細は、tall 配列を参照してください。

使用上の注意および制限:

saveLearnerForCoder、loadLearnerForCoderおよびcodegen(MATLAB Coder) を使用して、関数predictのコードを生成します。saveLearnerForCoderを使用して、学習済みモデルを保存します。loadLearnerForCoderを使用して保存済みモデルを読み込んで関数predictを呼び出す、エントリポイント関数を定義します。次に、codegenを使用して、エントリポイント関数のコードを生成します。predictの単精度の C/C++ コードを生成するには、loadLearnerForCoder関数を呼び出すときにDataType="single"を指定します。次の表は、

predictの引数に関する注意です。この表に含まれていない引数は、完全にサポートされています。引数 注意と制限 mdlClassificationKNNモデル オブジェクトは、対応するコンパクトなオブジェクトがない完全なオブジェクトです。このモデルの場合、saveLearnerForCoderはハイパーパラメーター最適化プロパティが含まれていないコンパクトなバージョンを保存します。mdlが kd 木探索アルゴリズムを使用して学習を行ったモデルであり、コード生成のビルド タイプが MEX 関数である場合、codegen(MATLAB Coder) は並列計算用に Intel® スレッディング ビルディング ブロック (TBB) を使用して MEX 関数を生成します。それ以外の場合、codegenはparfor(MATLAB Coder) を使用してコードを生成します。kd 木探索アルゴリズムの場合の MEX 関数 —

codegenは、マルチコア プラットフォームにおける並列計算用に Intel TBB を使用して、最適化された MEX 関数を生成します。この MEX 関数を使用して MATLAB アルゴリズムを高速化できます。Intel TBB の詳細については、https://www.intel.com/content/www/us/en/developer/tools/oneapi/onetbb.htmlを参照してください。生成された

parforバージョンのコードをテストするために MEX 関数を生成する場合、Intel TBB の使用を無効化できます。MEX 構成オブジェクトのExtrinsicCallsプロパティをfalseに設定します。詳細については、coder.MexCodeConfig(MATLAB Coder) を参照してください。網羅的探索アルゴリズムの場合の MEX 関数と、両方のアルゴリズムの場合のスタンドアロン C/C++ コード — 生成される

predictのコードでは、parfor(MATLAB Coder) を使用して、サポートされている共有メモリ マルチコア プラットフォームで並列的に動作するループが作成されます。コンパイラが Open Multiprocessing (OpenMP) アプリケーション インターフェイスをサポートしない場合、または OpenMP ライブラリを無効にした場合、MATLAB Coder™ はparforループをforループとして扱います。サポートされるコンパイラについては、サポートされるコンパイラを参照してください。OpenMP ライブラリを無効にするには、構成オブジェクトのEnableOpenMPプロパティをfalseに設定します。詳細については、coder.CodeConfig(MATLAB Coder) を参照してください。

モデル オブジェクトの使用上の注意および制限については、

ClassificationKNNオブジェクトのコード生成を参照してください。

XXは、単精度または倍精度の行列か、数値変数、カテゴリカル変数、またはその両方を含む table でなければなりません。Xの行数、または観測値の数は可変サイズにすることができますが、Xの列数は固定でなければなりません。Xを table として指定する場合、モデルは table を使用して学習させたものでなければならず、かつ予測のためのエントリポイント関数で次を行う必要があります。データを配列として受け入れる。

データ入力の引数から table を作成し、その table 内で変数名を指定する。

table を

predictに渡す。

この table のワークフローの例については、table のデータを分類するためのコードの生成を参照してください。コード生成における table の使用の詳細については、table のコード生成 (MATLAB Coder)およびコード生成における table の制限事項 (MATLAB Coder)を参照してください。

詳細は、統計と機械学習の関数のコード生成の紹介を参照してください。

使用上の注意および制限:

次のように指定された

ClassificationKNNモデルに対しては、predictで GPU 配列はサポートされません。NSMethodプロパティが"kdtree"として指定されている。Distanceプロパティが"fasteuclidean"、"fastseuclidean"、または関数ハンドルとして指定されている。IncludeTiesプロパティがtrueとして指定されている。

詳細は、GPU での MATLAB 関数の実行 (Parallel Computing Toolbox)を参照してください。

バージョン履歴

R2012a で導入

MATLAB Command

You clicked a link that corresponds to this MATLAB command:

Run the command by entering it in the MATLAB Command Window. Web browsers do not support MATLAB commands.

Web サイトの選択

Web サイトを選択すると、翻訳されたコンテンツにアクセスし、地域のイベントやサービスを確認できます。現在の位置情報に基づき、次のサイトの選択を推奨します:

また、以下のリストから Web サイトを選択することもできます。

最適なサイトパフォーマンスの取得方法

中国のサイト (中国語または英語) を選択することで、最適なサイトパフォーマンスが得られます。その他の国の MathWorks のサイトは、お客様の地域からのアクセスが最適化されていません。

南北アメリカ

- América Latina (Español)

- Canada (English)

- United States (English)

ヨーロッパ

- Belgium (English)

- Denmark (English)

- Deutschland (Deutsch)

- España (Español)

- Finland (English)

- France (Français)

- Ireland (English)

- Italia (Italiano)

- Luxembourg (English)

- Netherlands (English)

- Norway (English)

- Österreich (Deutsch)

- Portugal (English)

- Sweden (English)

- Switzerland

- United Kingdom (English)