selectModels

クラス: RegressionLinear

当てはめた正則化線形回帰モデルの選択

説明

入力引数

出力引数

例

ヒント

複数の線形回帰予測モデルを作成する方法の 1 つに、次のようなものがあります。

データの一部をテスト用にホールドアウトします。

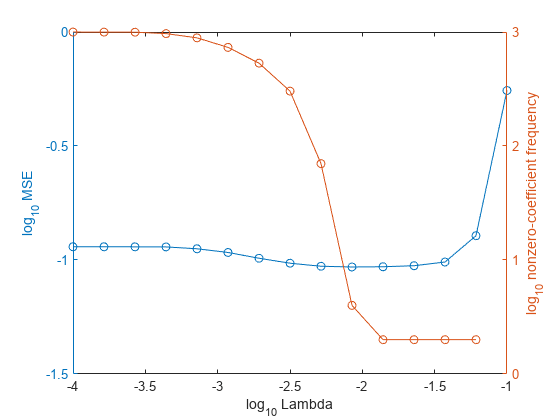

fitrlinearを使用して線形回帰モデルに学習をさせます。名前と値のペアの引数'Lambda'を使用して正則化強度のグリッドを指定し、学習データを与えます。fitrlinearは 1 つのRegressionLinearモデル オブジェクトを返しますが、これには各正則化強度に対するモデルが含まれています。各正則化モデルの品質を判断するため、返されたモデル オブジェクトとホールドアウトされたデータを

lossなどに渡します。満足できる正則化モデルのサブセットのインデックス (

idx) を識別し、返されたモデルとインデックスをselectModelsに渡します。selectModelsは 1 つのRegressionLinearモデル オブジェクトを返しますが、これにはnumel(idx)個の正則化モデルが含まれています。新しいデータのクラス ラベルを予測するため、データと正則化モデルのサブセットを

predictに渡します。