畳み込みニューラル ネットワークの特徴の可視化

この例では、畳み込みニューラル ネットワークによって学習された特徴を可視化する方法を説明します。

畳み込みニューラル ネットワークでは、"特徴" を使用してイメージを分類します。ネットワークは、学習プロセスでこれらの特徴自体を学習します。学習時にネットワークが学習する内容は、よくわからない場合もあります。ただし、関数 deepDreamImage を使用して、学習された特徴を可視化することができます。

"畳み込み" 層は、3 次元の活性化ボリュームを出力します。ここで、3 番目の次元に沿ったスライスは、層の入力に適用された 1 つのフィルターに対応します。ネットワークの終わりにある "全結合" 層によって出力されるチャネルは、それ以前の層によって学習された特徴の高度な組み合わせに対応しています。

deepDreamImage を使用して、ネットワーク層の特定のチャネルを強く活性化するイメージを生成することによって、学習された特徴を可視化できます。

この例には、Deep Learning Toolbox™ および Deep Learning Toolbox Model for GoogLeNet Network サポート パッケージが必要です。

事前学習済みのネットワークの読み込み

事前学習済みの GoogLeNet ネットワークと対応するクラス名を読み込みます。これには、Deep Learning Toolbox™ Model for GoogLeNet Network サポート パッケージが必要です。このサポート パッケージがインストールされていない場合、ソフトウェアによってダウンロード用リンクが表示されます。使用可能なすべてのネットワークについては、事前学習済みの深層ニューラル ネットワークを参照してください。

[net,classNames] = imagePretrainedNetwork("googlenet");初期の畳み込み層の可視化

GoogLeNet ネットワークには、複数の畳み込み層があります。ネットワークの最初の方の畳み込み層では、受容野のサイズが小さく、学習する特徴は小さく低水準になります。ネットワークの最後の方の層では、受容野のサイズが大きく、学習する特徴が大きくなります。

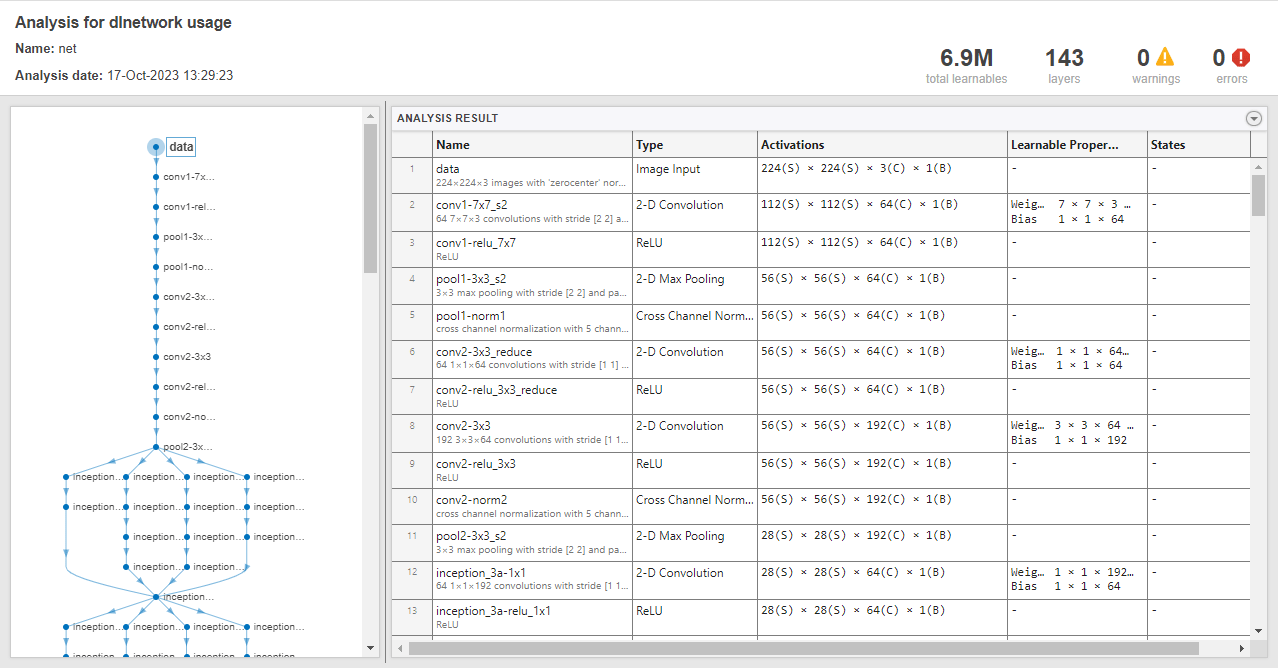

analyzeNetwork を使用して、ネットワーク アーキテクチャを表示し、畳み込み層の位置を確認します。

analyzeNetwork(net)

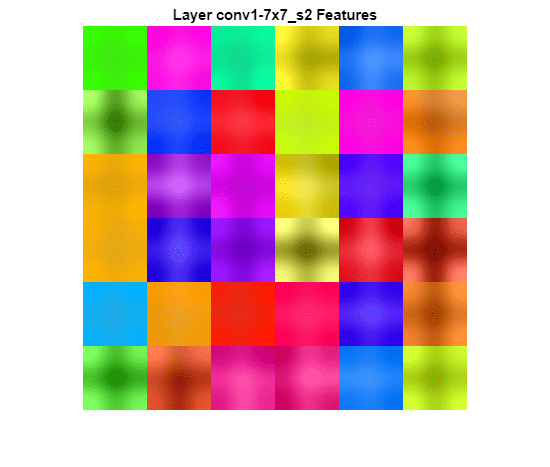

畳み込み層 1 の特徴

layer を最初の畳み込み層になるように設定します。この層はネットワークの 2 番目の層であり、'conv1-7x7_s2' という名前が付いています。

layer = 2; name = net.Layers(layer).Name

name = 'conv1-7x7_s2'

channels をインデックスのベクトル 1:36 に設定することによって、deepDreamImage を使用してこの層で学習された最初の 36 個の特徴を可視化します。'PyramidLevels' を 1 に設定し、イメージがスケーリングされないようにします。イメージをまとめて表示するには、imtile を使用できます。

deepDreamImage では既定で、互換性のある GPU が利用できる場合は、その GPU が使用されます。そうでない場合は CPU が使用されます。GPU を使用するには、Parallel Computing Toolbox™ とサポートされている GPU デバイスが必要です。サポートされているデバイスの詳細については、GPU 計算の要件 (Parallel Computing Toolbox)を参照してください。

channels = 1:36; I = deepDreamImage(net,name,channels, ... 'PyramidLevels',1);

|==============================================| | Iteration | Activation | Pyramid Level | | | Strength | | |==============================================| | 1 | 15.84 | 1 | | 2 | 423.25 | 1 | | 3 | 849.50 | 1 | | 4 | 1275.84 | 1 | | 5 | 1702.21 | 1 | | 6 | 2128.59 | 1 | | 7 | 2554.97 | 1 | | 8 | 2981.36 | 1 | | 9 | 3407.74 | 1 | | 10 | 3834.13 | 1 | |==============================================| Training finished: Max epochs completed.

figure I = imtile(I,'ThumbnailSize',[64 64]); imshow(I) title(['Layer ',name,' Features'],'Interpreter','none')

これらのイメージの多くには、エッジと色が含まれます。これは、'conv1-7x7_s2' 層のフィルターがエッジ検出器およびカラー フィルターであることを示します。

畳み込み層 2 の特徴

2 番目の畳み込み層は 'conv2-3x3_reduce' という名前で、層 6 に対応します。channels をインデックスのベクトル 1:36 に設定することによって、この層で学習された最初の 36 個の特徴を可視化します。

最適化プロセスで詳細な出力を表示しないようにするには、deepDreamImage を呼び出すときに 'Verbose' を 'false' に設定します。

layer = 6; name = net.Layers(layer).Name

name = 'conv2-3x3_reduce'

channels = 1:36; I = deepDreamImage(net,name,channels, ... 'Verbose',false, ... 'PyramidLevels',1, ... 'OutputScaling',"clipped"); figure I = imtile(I,'ThumbnailSize',[64 64]); imshow(I) name = net.Layers(layer).Name; title(['Layer ',name,' Features'],'Interpreter','none')

この層のフィルターは、最初の畳み込み層よりも複雑なパターンを検出できます。

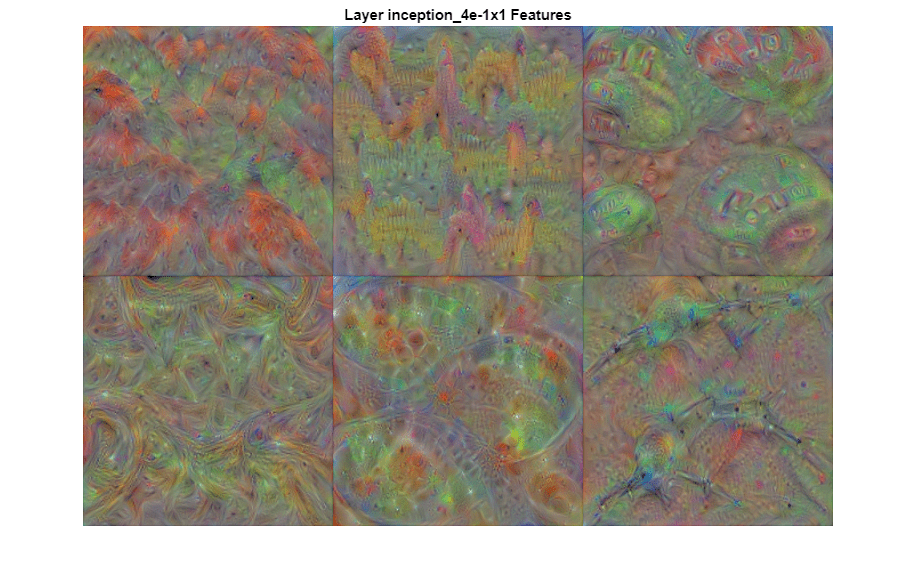

より深い畳み込み層の可視化

深い層では、それ以前の層によって学習された特徴の高水準の組み合わせを学習します。

ピラミッド レベルの数およびピラミッド レベル 1 つあたりの反復回数を増やすと、計算量が増加しますが、より詳細なイメージを生成できます。反復の回数を増やすには 'NumIterations' オプションを使用し、ピラミッド レベルの数を増やすには 'PyramidLevels' オプションを使用します。

layer = 97; name = net.Layers(layer).Name

name = 'inception_4e-1x1'

channels = 1:4; I = deepDreamImage(net,name,channels, ... 'Verbose',false, ... "NumIterations",20, ... 'PyramidLevels',2, ... 'OutputScaling', "clipped"); figure I = imtile(I,'ThumbnailSize',[224 224]); imshow(I) name = net.Layers(layer).Name; title(['Layer ',name,' Features'],'Interpreter','none')

ネットワークの層が深くなるほどフィルターが詳細になり、複雑なパターンとテクスチャが学習されていることに注意してください。

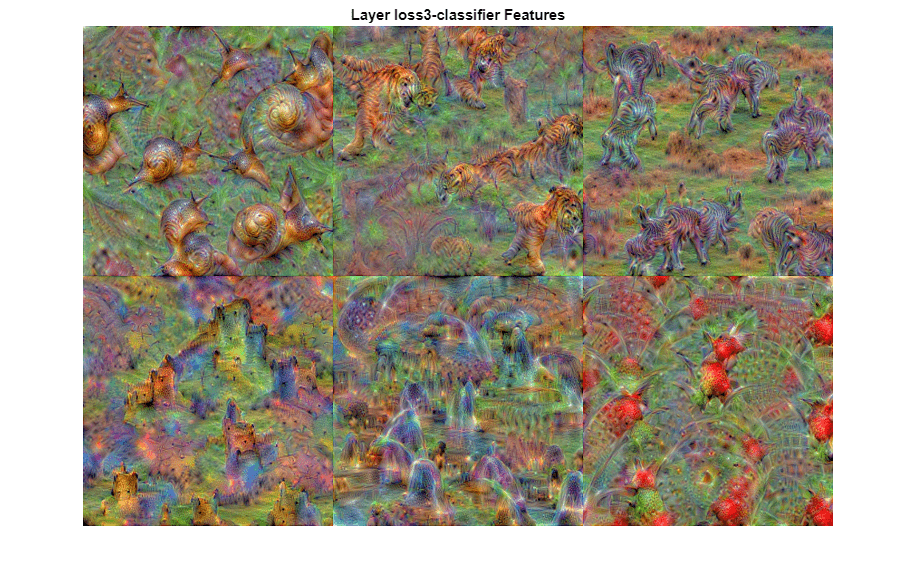

全結合層の可視化

各クラスに最も似たイメージを生成するには、全結合層を選択し、channels をクラスのインデックスに設定します。

全結合層 (層 142) を選択します。

layer = 142; name = net.Layers(layer).Name

name = 'loss3-classifier'

可視化するクラスを選択するには、channels をこれらのクラス名のインデックスに設定します。

channels = [114 293 563 950];

クラスは、出力層 (最後の層) の Classes プロパティに格納されます。channels のエントリを選択することによって、選択されたクラスの名前を表示できます。

classNames(channels)

ans = 4×1 string

"snail"

"tiger"

"fountain"

"strawberry"

これらのクラスを強く活性化する詳細なイメージを生成します。deepDreamImage を呼び出すときに 'NumIterations' を 100 に設定すると、より詳細なイメージが生成されます。全結合層で生成されたイメージは、イメージ クラスに対応しています。

I = deepDreamImage(net,name,channels, ... 'Verbose',false, ... 'NumIterations',100, ... 'PyramidLevels',2, ... 'OutputScaling', "clipped"); figure I = imtile(I,'ThumbnailSize',[224 224]); imshow(I) name = net.Layers(layer).Name; title(['Layer ',name,' Features'])

生成されたイメージは選択されたクラスを強く活性化しています。

参考

imagePretrainedNetwork | dlnetwork | trainingOptions | trainnet | deepDreamImage | occlusionSensitivity | gradCAM | imageLIME